Marketing Decision Stack'in En Kritik Katmanı Hangisi? Çoğu Lider Yanlış Cevaplıyor

The Decision Policy Layer: Pazarlama Kararlarının Görünmez Mimarisi

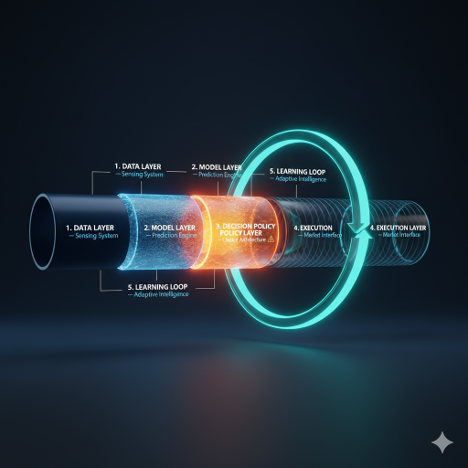

"AI in Marketing" yazı dizisinin bu bölümü, Marketing Decision Stack'in (Pazarlama Karar Yığını) kalbini oluşturan Karar Politikası Katmanı'nı derinlemesine inceliyor. Birinci bölümde tanımladığımız yığın şu sırayla ilerliyordu: Veri → Model → Karar Politikası → Uygulama → Öğrenme Döngüsü. Şimdi o zincirin tam ortasına ve en çok göz ardı edilen halkasına odaklanıyoruz.

Hız, Gücü Artırmaz Zayıflığı Büyütür

Yapay zekanın pazarlamaya getirdiği en büyük vaat, karar alma kapasitesini ölçeklendirmektir. Bir optimizasyon yöneticisinin günde belki yüz karar aldığı noktada, bir AI sistemi milyonlarca kararı saniyeler içinde çalıştırabilir. Bu hız, çoğu zaman kendi başına bir erdem olarak sunulur. Oysa bir sistem mimarisi açısından bakıldığında, hız bir kaldıraçtır. Hem doğru hem de yanlış kararları eşit biçimde büyütür.

Bunu bir asansör metaforuyla düşünelim. Asansörün motorunu güçlendirmek onu daha hızlı hareket ettirir. Ancak gideceği katı belirleyen mekanizma, düğmeler, güvenlik sensörleri, kontrol devresi zayıfsa, daha güçlü motor sizi doğru kata değil, daha hızlı yanlış kata götürür.

Pazarlama AI sistemlerinde bu "kontrol devresi", Karar Politikası Katmanı'dır (Decision Policy Layer). Bir modelin istatistiksel çıktısını ("Bu kullanıcı büyük olasılıkla satın alacak") operasyonel bir aksiyona ("Şimdi bu fiyatla bu mesajı gönder") dönüştüren soyut ama kritik katman. Ve bugün gözlemleyebildiğimiz pazarlama krizlerinin büyük çoğunluğu, model hatasından değil politika boşluklarından kaynaklanmaktadır. Rakamlar bu tabloyu net biçimde doğruluyor. IBM Global AI Adoption Index 2025'e göre pazarlama ekiplerinin %76’sı AI'ı temel operasyonlarında kullanıyor; bu oran 2021'deki %29’a kıyasla 162 puanlık bir artışı temsil ediyor. Ancak aynı dönemde McKinsey'nin küresel AI olgunluğu araştırması,organizasyonların %80’ininden fazlasının yapay zekadan henüz ölçülebilir işletme kâr etkisi göremediğini ortaya koyuyor. Teknoloji, politika katmanından çok daha hızlı ilerliyor. Ve bu makas her geçen çeyrek genişliyor.

Policy Layer Neden Çöker?

Karar Politikası Katmanı, teoride üç temel işlevi yerine getirir:

Kısıtlama Yönetimi (Constraint Management): Modelin önerdiği aksiyonların yasal, etik ve marka sınırları içinde kalmasını sağlamak. Örneğin: "Tahminimiz doğru olsa bile bu segmente bu fiyatı gösterme."

Hedef Dengeleme (Objective Balancing): Birbiriyle çelişen metrikleri (kısa vadeli gelir vs. müşteri yaşam boyu değeri, tıklama oranı vs. marka algısı) yönetmek.

Geri Bildirim Filtreleme (Feedback Filtering): Öğrenme döngüsünün hangi sinyalleri optimize edeceğini seçmek. Neyi öğrendiğini bilmeyen bir sistem, en iyi ihtimalle tesadüfen doğru şeyleri öğrenir.

Bu üç işlevin herhangi birindeki tasarım zayıflığı, Policy Layer Risk olarak tanımlanabilir: sistemin teknik olarak çalışması ancak yanlış şeyi mükemmel biçimde optimize etmesi durumu.

Policy Layer Risk'in en yaygın üç tezahürü şöyle sıralanabilir:

- Proxy Metric Çöküşü: Sistem gerçek hedefi (müşteri memnuniyeti, sürdürülebilir gelir) değil, ölçülmesi kolay bir proxy'i (tıklama oranı, kısa vadeli dönüşüm) maksimize etmek üzere optimize edilmiştir. Zamanla bu iki hedef ayrışır ve sistem, kağıt üzerinde performans gösterirken gerçek değeri eritir.

- Kısıtsız Genişleme: Politika katmanı, başlangıçta makul sınırlarla tasarlanmıştır. Ancak A/B testleri ve reinforcement learning döngüleri bu sınırları aşamalı olarak esnetir. Kimse bilinçli bir karar almamıştır; sistem yavaş yavaş sınırı aşındırır.

- Etik Fay Hattı Aktivasyonu: Modelin tahmin gücü, kullanıcının farkında olmadığı bir hassas noktayı tespit ettiğinde ve politika katmanı bu tespiti kısıtlamadan aksiyona dönüştürdüğünde, bir Ethical Faultline (Etik Fay Hattı) tetiklenir. Sistem teknik olarak kusursuz çalışmaktadır. Ancak bu mükemmellik, etik olarak kabul edilemez bir zemine dayanmaktadır.

Etik Fay Hattı: Algoritmanın Duygusal Körlüğü

Spotify Wrapped 2024: "Biggest Wrapped Ever" — Ama Neden Bu Kadar Kötü Hissettirdi?

Etik Fay Hattı her zaman bir gizlilik ihlali ya da yasal bir sınırı aşmak biçiminde tezahür etmez. Bazen tahmin algoritmasının "başarısı" kullanıcının paylaşmadığı ama sistemin çıkarsadığı duygusal bir bağlamı fark etmesi ve bunla ilgili içerik üretmesi tam da bu mükemmelliği yüzünden bir krize dönüşür. Spotify Wrapped 2024, bu dinamiğin küresel ölçekte yaşanan en çarpıcı örneğidir.

4 Aralık 2024'te yayımlanan Spotify Wrapped, önceki yılların aksine derin bir hayal kırıklığı dalgasıyla karşılandı. Olayın iki katmanı vardı ve her biri ayrı bir politika hatası taşıyordu.

Birinci katman teknikti: AI algoritması, kullanıcıların dinleme verilerini analiz ederek "Music Evolution" adlı yeni bir özellik sundu. Sistem, kullanıcıların müzik zevklerini "Shimmer Pop", "Slop Rock", "Cottagecore Trap", "Pink Pilates Princess", "Coastal Grandmother" gibi AI üretimi mikro-tür etiketleriyle sınıflandırdı. WIRED, bu etiketlerin büyük bölümünün gerçek müzik tarzlarına karşılık gelmediğini; sistemin dinleme verisini değil, algoritmik çağrışımları yansıttığını belgeledi. TechReport, kullanıcıların en çok dinlediği şarkı ve sanatçıların da hatalı raporlandığını saptadı. Gwyneth Paltrow dahil onlarca tanınmış kullanıcı, sistemin kendi dinleme alışkanlıklarını yanlış raporladığını kamuoyuyla paylaştı.

İkinci ve çok daha ağır katman ise insan boyutuydu. Spotify, 2024 Wrapped'e AI tarafından üretilen bir podcast özelliği ekledi. Google'ın NotebookLM teknolojisiyle geliştirilen bu özellik, her kullanıcının yıllık dinleme verisini iki yapay ses tarafından sunulan beş dakikalık bir podcast'e dönüştürüyordu. Ekim 2024'te 31 yaşında hayatını kaybeden One Direction üyesi Liam Payne'in ardından milyonlarca kullanıcının platforma akın etmesi, One Direction dinleme istatistiklerini dramatik biçimde yükseltti. Wrapped AI podcast'i bu veriyi algoritmik olarak işledi ve "One Direction klasikleri, değil mi? Ne kadar cool" benzeri yorumlar üretti. Kaybı henüz işlemeye çalışan kullanıcılar, algoritmanın matem dönemlerine ilişkin veriyi bir içerik fırsatı olarak değerlendirdiğini gördü. Tepkiler şiddetliydi: "Bu kadar iğrenç bir şey görmedim" yazan kullanıcılar sosyal medyayı doldurdu.

Sonuç ölçülebilirdi. Medya istihbarat firması CARMA'nın verilerine göre Wrapped 2024'ün yayımlanmasının ardından Spotify'ın marka olumlu algısı %50’nin üzerinden %41.5’a düştü. Spotify'ın ortak başkanı ve CPO'su Gustav Söderström, Stockholm'deki Open House etkinliğinde şunu itiraf etti: "Rakamlara bakıldığında bu en büyük Wrapped oldu. Ama daha önce hiç görmediğimiz kadar olumsuz geri bildirim aldık."

Bu vaka, Etik Fay Hattı'nın ne anlama geldiğini çarpıcı biçimde gösteriyor. Politika katmanının önüne koyduğu soru yalnızca "Bu veri neler söylüyor?" idi. Sorması gereken soru ise "Bu verinin içinde insan duygusunun ne kadarı var ve bunu algoritmik içerikle işlemek etik mi?" idi. Sistem başarılı çalıştı; kriz oradan doğdu.

2025'te Spotify bu dersi kabul etti. Adweek, Aralık 2025'te Spotify Wrapped 2025'in "yapay zeka baskısına karşı daha insani bir dokunuşla" yeniden tasarlandığını haberleştirdi. Şirket, AI podcast özelliğini tamamen kaldırdı; tür etiketlerini insan editoryal süzgecinden geçirir hale getirdi. Bir yıllık geri bildirim döngüsü, politika katmanını sıfırdan yeniden yazan tek veri noktası oldu.

Güven istatistikleri bu dinamiği sayısal olarak doğruluyor: Gartner'ın Ekim–Kasım 2025 tarihli araştırmasına göre tüketicilerin %78’i, AI tarafından üretilen içeriklerin açıkça etiketlenmesini "çok önemli" ya da "güveni korumak için en önemli faktör" olarak değerlendiriyor. Edelman Trust Barometer 2025 ise marka güveninin artık fiyat ve kaliteyle eşdeğer bir satın alma kriteri haline geldiğini saptıyor; tüketicilerin %80’i, kullandıkları markalara diğer kurumlardan çok daha fazla güvendiklerini ifade ediyor. Ama bu güven; algoritmanın duygusal bağlamı işlemesi gerektiğinde politika katmanı devreye girmezse, en yüksek teknik performansta bile çöküveriyor.

Ekonomik/Yasal Policy Risk: Algoritmanın Gizli Fiyat Teklifi

Instacart'ın Eversight Krizi — Küresel Ders, Aralık 2025

Karar politikasının en tehlikeli formu, herhangi bir bireysel kararın tek başına hukuka aykırı görünmediği, ancak sistemin bütünleşik mantığının tüketici güvenini fiilen ortadan kaldırdığı durumlarda ortaya çıkar. Instacart vakası, bu dinamiğin hem bir ders kitabı örneği hem de küresel bir uyarı işareti niteliğini taşıyor.

Aralık 2025'te Consumer Reports ve Groundwork Collaborative tarafından yayımlanan araştırma, Instacart'ın AI destekli fiyatlandırma aracı Eversight'ın aynı mağazada aynı ürünler için farklı müşterilere farklı fiyatlar gösterdiğini belgeledi. Deneyin boyutu çarpıcıydı: 437 gönüllü alışverişçinin tamamı algoritmik fiyat deneylerine maruz kalmıştı. Tek bir Safeway mağazasında bir düzine yumurta, beş farklı fiyat noktasıylasunuldu. Aynı sepet için fiyat farkı ortalama yüzde yedi olarak ölçüldü; bu oran yıllık bazda bazı müşteriler için yaklaşık 1.200 dolar ek maliyete dönüşebiliyordu. Safeway'in özel markalı Corn Flakes kutusunda ise tek bir ürünün fiyatı müşteriye göre yüzde yirmi üç oranında farklılaşabiliyordu.

FTC soruşturmasının başlaması, onlarca kongre üyesinin Instacart'a resmi yazılar göndermesi ve kamuoyunun şiddetli tepkisi üzerine şirket 22 Aralık 2025'te geri adım atmak zorunda kaldı: tüm fiyat testleri anında ve kalıcı olarak durduruldu. Şirket açıklamasında kullandığı ifadeler, politika katmanı tasarımı açısından son derece öğretici: "Müşterilerimizin geri bildirimlerini dikkatlice dinledik. Müşterileri fiyatları sorgulatır hale getiren testler hedefi tutturamadı. Bu durum özellikle güven, şeffaflık ve uygun fiyat üzerine kurulu bir şirket için kabul edilemez."

Bu vaka, pazarlama liderlerine evrensel bir ders veriyor: Tüketiciler aynı kasaya aynı ürün için farklı fiyat ödediğini öğrendiğinde, algoritmik gerekçeyi dinlemez. Şirkete duyduğu güveni yitirir. Consumer Reports'un Eylül 2025 tarihli araştırması, Instacart'ı daha önce kullananların yüzde yetmiş ikisinin herhangi bir nedenle farklı fiyatlandırma yapılmasını istemediklerini ortaya koyuyor. Politika katmanının "nasıl çalıştığı" değil, "nasıl hissettirdiği" karar verici olmaya devam ediyor.

Bu vakanın kritik boyutu şudur: Instacart'ın fiyatlandırma algoritması muhtemelen istatistiksel olarak tutarlı biçimde çalışıyordu. Model doğruydu. Ancak politika katmanı şu soruyu sormamıştı: "Kullanıcılarımız bu deneyin içinde olduklarını biliyor mu?" Şeffaflık boşluğu, teknik başarıyı güven krizine dönüştürdü.

Marka Güvenliği: Verimliliğin Gözden Kaçırdığı Şey

H&M'in "Digital Twins" Devrimi ve Sessiz Bedelinin Anatomisi — Mart 2025

Üçüncü risk vektörü, maliyet verimliliği hedefleyen otonom kararların marka kimliğiyle ve daha da önemlisi, yaratıcı emek ekosistemine duyulan güvenle çarpıştığı noktada ortaya çıkıyor. Mart 2025'te H&M, dünyanın en büyük moda perakendecilerinden biri sıfatıyla cesur bir adım attı: 30 gerçek modelinin dijital ikizlerini (digital twins) oluşturarak pazarlama içeriklerinde kullanmayı planladığını duyurdu. Şirketin Chief Creative Officer'ı Jörgen Andersson girişimi "yaratıcı sürecimizi geliştiren ve insan merkezli yaklaşımımızı temelden değiştirmeyen" bir adım olarak tanımladı. Modeller kendi dijital ikizlerinin haklarınıelinde bulunduracak, bu ikizleri başka markalar dahil istedikleri her müşteriye lisanslayabilecekti.

Tepki ise hızlı ve bölünmüş geldi. Model Alliance kurucusu Sara Ziff, "anlamlı korumalar olmaksızın dijital replika kullanımı" konusundaki ciddi endişelerini kamuoyuyla paylaştı. İngiltere'nin önde gelen sahne sanatları sendikası Equity, modellerin haklarını güvence altına alacak yasal çerçeveler olmaksızın böyle bir uygulamanın tehlikeli emsal oluşturabileceği uyarısında bulundu. Fotoğrafçılar, stilistler, makyaj sanatçıları ve set tasarımcıları yani kamera önündeki modelin değer yaratmasına aracılık eden tüm ekosistem sesini yükseltti.

H&M vakası, politika katmanındaki "kapsam körlüğü" sorununu somut biçimde ortaya koyuyor. Şirketin politika tasarımı net bir birincil hedef üzerine kuruluydu: verimliliği artır, içerik üretim maliyetlerini düşür, modellere ek gelir sağla. Bu üç hedef kendi içinde savunulabilir, hatta ilericiydi. Ancak politika katmanı kritik bir yan etkiyi görememişti: sistemin "kazananları" açıkça tanımlanmıştı ama "kaybedenler" — kamera önündeyken görünmez olan emeğin sahipleri — sistematik olarak görmezden gelinmişti.

Bu "görünmez zarar" boyutu, markanın itibar maliyeti açısından belirleyici oldu. H&M onlarca yıldır inşa ettiği "demokratik moda" kimliğini koruma kaygısıyla adım atarken, kritik kitlelerinin gözünde "yaratıcı emeği dışlayan bir otomasyoncu" olarak çerçevelendi. Tasarruf hesaplanmıştı; itibar bedeli hesaplanmamıştı.

DesignRush'ın Ocak 2026 tarihli analizinin saptadığı üç örüntü bu vakada da kendini gösteriyor: maliyet tasarrufları kültürel hasar maliyetini karşılamıyor; köklü markalar AI deneyleriyle orantısız daha büyük risk taşıyor; lüks ve prestij tüketicileri yapay zekaya en düşük toleransı gösteriyor. H&M, bu üç örüntünün kesişim noktasında bir politika kararı almıştı.

Bu üç vaka, küresel ölçekte yaşanan güven erozyonunun yerel örnekleri. Rakamlar, sorunun sistemik boyutunuortaya koyuyor:

McKinsey'nin Küresel AI Güven Olgunluğu Araştırması, sorumlu AI uygulamalarına yatırım yapan şirketlerin, yapmayanlara kıyasla tüketici güveninde %34, marka itibarında %29 ve AI kaynaklı olaylarda %22 iyileşme kaydettiğini saptıyor. Yani güven yönetimi soyut bir değer değil, ölçülebilir bir rekabet avantajı.

Gartner'ın Eylül 2025 tarihli araştırması ise daha provokatif bir tablo çiziyor: tüketicilerin %53’ü AI destekli arama sonuçlarına güvenmiyor ve tüketicilerin %61’i AI özetlerini açıp kapatabilecek bir kontrol mekanizması talep ediyor. Kullanıcı özerkliği, artık bir "isteğe bağlı özellik" değil — temel bir güven bileşeni.

Bu güven, markaların elinde beklenmedik derecede yüksek bir sermaye. Ve bu sermayenin en hızlı tahrip yolu, kullanıcıların fark etmeden bir deneyin parçası haline getirilmesi.

Stratejik Framework: Dual-Objective AI

Üç vakayı birlikte analiz ettiğimizde, tek boyutlu optimize edilmiş sistemlerin yapısal kırılganlığı net biçimde görülüyor. Her birinde, çok iyi işleyen bir model ve yetersiz tasarlanmış bir politika katmanı bir aradabulunuyor. Bu gözlem, pazarlama AI mimarisi için köklü bir yeniden çerçeveleme gerektiriyor.

Dual-Objective AI (İkili Hedefli Yapay Zeka) modeli, karar politikası katmanının eş zamanlı iki hedefe hizmet etmesi gerektiği ilkesine dayanır:

Hedef 1 — Performans: Gelir, dönüşüm, engagement, maliyet etkinliği gibi geleneksel pazarlama metrikleri. Bu hedef, çoğu sistemde hâlihazırda önceliklendirilmiştir.

Hedef 2 — Güven: Müşteri özerkliğini koruyan, düzenleyici sınırlar içinde kalan, marka kimliğiyle tutarlı ve uzun vadeli ilişki değeri yaratan karar desenleri.

Bu iki hedef çoğu zaman kısa vadede çelişir. Gizli bir fiyatlandırma algoritması marjı artırabilir, ancak güveni yok eder. "Varsayılan açık" bir içerik erişimi kişiselleştirmeyi zenginleştirebilir, ancak şeffaflık beklentisiyleçelişir. Otonom kreatifte maliyet verimliliği sağlanabilir, ancak yaratıcı emeğin değerine duyulan toplumsalsaygıyla çatışır.

Dual-Objective AI modeli, bu gerilimleri gizlemez; aksine görünür ve yönetilebilir hale getirir. Pratik uygulamada bu yaklaşım dört operasyonel ilkeye dönüşür:

Performans-Güven Pareto Sınırı: Her karar politikası konfigürasyonu için açıkça tanımlanmış bir trade-off eğrisi. "Bu konfigürasyonda X geliri kazanıyoruz, Y güven maliyetine katlanıyoruz" sorusu bir çeyrek dönem sonunda değil, karar tasarımı aşamasında yanıtlanmalıdır.

Etik Fay Hattı Haritalaması: Hangi veri tiplerine dayanan hangi kararların etik kırılma riskini barındırdığının önceden tanımlanması. "Bu fiyatlandırma kararında müşteri bunu biliyor mu?", "Bu içerik kararında görmezden geldiğimiz bir paydaş grubu var mı?" soruları politika tasarımının başlangıç kontrol listesine dahil edilmeli.

Kısıtlama Hiyerarşisi: Politika katmanının hangi kısıtlamaların "asla geçilemez" (etik ve yasal sınırlar), hangilerinin "tercih edilen" (marka standartları) ve hangilerinin "optimize edilebilir" (performans metrikleri) olduğunu açıkça kodlaması.

İnsan-Döngü Eşik Protokolü (Human-in-the-Loop Threshold Protocol): Hangi karar kategorilerinin otonom yürütüleceğini, hangilerinin insana yönlendirileceğini tanımlayan bir eşik sistemi. Bu, tüm kararların insanlara danışılması gerektiği anlamına gelmiyor; yalnızca yüksek riskli karar kategorilerinde otonom yetki sınırının tanımlanması anlamına geliyor.

Policy Layer Risk'in Kurumsal Anatomisi

Karar Politikası Katmanı genellikle bir organizasyonda kim tarafından sahiplenilir? Tipik yanıt şaşırtıcıdır: kimse.

Veri bilimciler modeli tasarlar. Mühendisler sistemi inşa eder. Pazarlama ekibi hedefleri tanımlar. Hukuk departmanı düzenleyici kısıtlamaları belirler. CFO maliyet yapısına karar verir. Ancak bu beş aktörün kısıtlamalarını, hedeflerini ve değiş tokuşlarını bir araya getirip bütünleşik bir karar politikası oluşturan net bir sahiplenme noktası çoğu organizasyonda yoktur.

Bu boşluk, Policy Layer Risk'in kurumsal köküdür. Ve bu boşluk, teknoloji yatırımı yaparak değil, organizasyonel tasarım değişikliğiyle kapatılır. Yükselen "Chief AI Officer" rolünün en kritik görevi, modelleri değil politika katmanlarını yönetmektir. Çünkü modeller matematiksel araçlardır; politika katmanları ise kurumsal değer sisteminin yürütme mekanizmasıdır.

2025 yılının vaka silsilesi — gizli fiyat deneylerinden dijital emek krizlerine, filtreleme şeffaflığı eksikliklerinden marka güveni çöküşlerine — hepsinin ortak paydası aynıdır: teknik olarak çalışan modeller,etik ve stratejik kısıtlamaları yetersiz kodlanmış politika katmanlarıyla buluşunca üretilen hasarlar. Bu hasar,McKinsey'nin küresel araştırmasının gösterdiği üzere, yalnızca itibar kaybına değil — ölçülebilir EBIT kaybına da dönüşüyor.

"AI does not make decisions. Decision systems do."

Bir model çıktı üretir. Hangi çıktının hangi koşulda nasıl eyleme dönüşeceğini ve hangisinin dönüşmeyeceğini karar sistemi, yani politika katmanı belirler. Bu ayrımı göremeyen organizasyonlar, en gelişmiş modellerle bile yanlış kararlar almaya devam eder.

AI yatırım kararlarınızı değerlendirirken kendinize şu iki soruyu sorun:

Pazarlama Liderlerine: Fiyatlandırma, kişiselleştirme veya içerik üretiminde kullandığınız AI araçları, müşterilerinizi bilgilendirmeden bir algoritmanın deney değişkeni haline getiriyor mu — ve müşterileriniz bunuöğrendiğinde marka güveninizin ne kadarının hâlâ yerinde olacağını hesapladınız mı?

C-Level Yöneticilere: AI sistemlerinizin yarattığı değeri takip eden metrikleriniz var; peki ya bu sistemlerin yok ettiği güveni, görmezden geldiği paydaşları ve büyüyen etik yükümlülükleri takip eden bir ölçüm çerçeveniz var mı?

Bir Sonraki Bölüm: Exploration Debt

Organizasyonunuz AI pazarlama sistemlerini devreye aldıkça, her gün birikmeye başlayan görünmez bir borç var: Exploration Debt (Keşif Borcu). Sisteminiz optimize ettiği şeyleri giderek daha iyi yapıyor ancak hiç keşfetmediği müşteri segmentleri, test etmediği yaratıcı yaklaşımlar ve denemediği kanal kombinasyonları için kalıcı bir kör nokta oluşuyor.

Bu borç, bazen finansal borçtan daha sinsi biçimde büyür: sessizce ve faiz biriktirerek. Üçüncü bölüm, bir AI sisteminin ne öğrendiği kadar ne öğrenmediğinin neden kritik bir stratejik risk olduğunu inceleyeceğiz.

Yorumlar