Gölge Yapay Zeka

Bilindiği üzere yapay zekanın hayatımıza girişi ile meslekler ve iş yapış şekilleri farklı bir yöne evrildi. Takımlar içerisinde eskiden bir insanın yaptığı işi yapan yapay zeka ajanları var. Eskiden o işi yapan insan da, yapay zeka ajanından verimli, fonksiyonel ve etik şekilde faydalanabilecek yöntemleri bulmaya odaklanıyor. Ya da eskiden yaptığı işi yapay zeka araçlarını kullanarak geliştiriyor.

Örneğin, yazılım ürünü geliştiren bir takımda kullanıcı deneyimi yetkinliğinin eksik olduğu fark edildiğinde ilk refleks; “yöneticiler ile konuşalım”, “ihtiyacı anlatalım”, “takıma bu yetkinliği dahil edelim”, belki “IK ile görüşüp ilan çıkalım.” olurdu. Şu anda ise ilk refleks “bunu yapan, ihtiyacımızı karşılayan bir yapay zeka aracı var mı araştıralım.” oluyor. Sonra ihtiyacın büyüklüğüne göre “insan UX designer”, “AI UX designer” arasında seçim yapmak için tartışılıyor. Ya da UX designer’ler önceden tüm şirketin ihtiyacını karşılamak konusunda, zaman açısından zorlanan bir haldeyken, artık ürünlerin yolcuğunu, ihtiyacını AI UX designere en iyi şekilde tarifleyip daha hızlı çözümler üretiyor.

Bir başka örnek ise sağlık kliniğinde kaliteden sorumlu bir kalite uzmanını düşünelim. Önceden kliniğin kalite süreçlerini, belgelendirme gereksinimlerini, temiz oda kriterlerini vb. tek tek kontrol edip bulgularını rapor olarak yazarken, denetimlerini yaptıktan sonra notlarını yükleyip yapay zekaya rapor yazdırabiliyor.

Dediğim gibi ihtiyaca, ihtiyacın büyüklüğüne, sektöre ve diğer birçok faktöre göre bu durum değişiyor. Fakat kesin olan bir şey var ki artık işin uzmanları el oyalayıcı işleri yapmaktan ziyade, o işi yapay zeka araçlarına yaptırıp, daha katma değerli işleri yapmakla ilgileniyor.

Burada ise bazı riskler ortaya çıkıyor. AI’ın yaptığı işin kalitesi, ihtiyacı karşılamaması vb. riskler var. Ama ben bu yazıda başka bir riskten bahsedeceğim. Bilinçsiz ve rasgele kullanılan AI araçlarının yarattığı güvenlik riski.

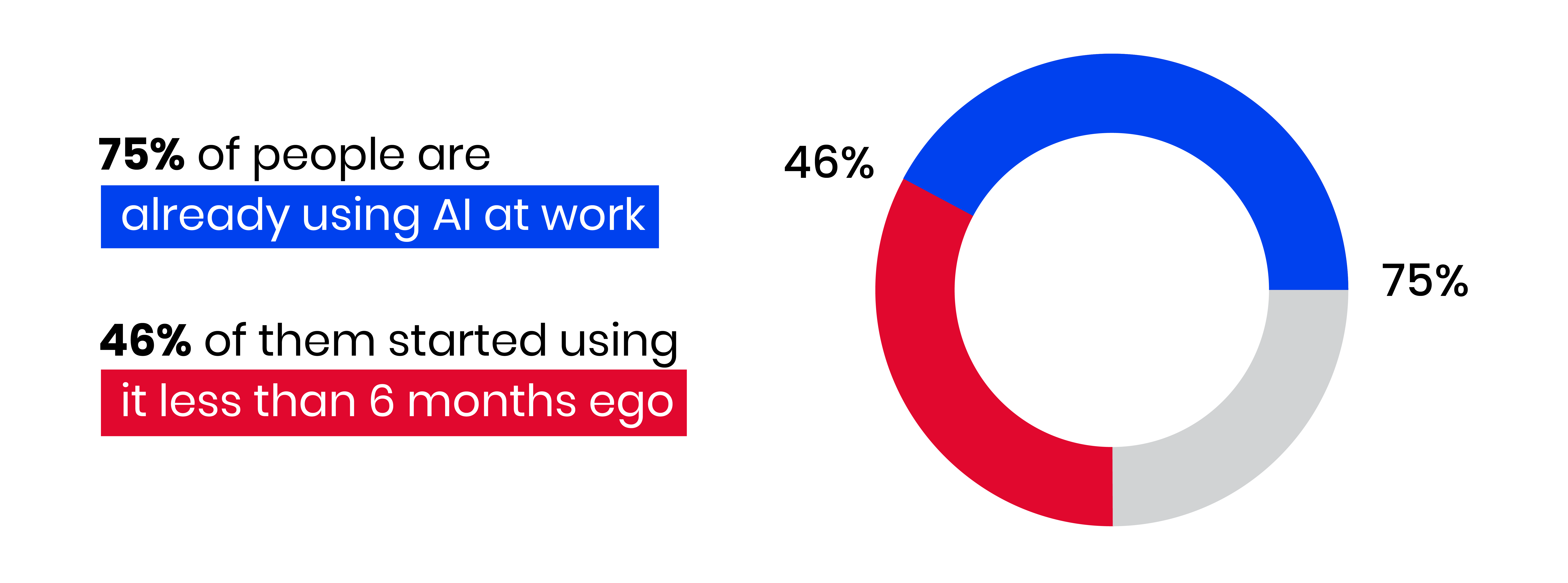

Bu riskten bahsettiğimizde Gölge Yapay Zeka (Shadow AI) kavramı ortaya çıkıyor. Bir şirkette çalışanların, bilgi işlem (BT) veya güvenlik departmanının haberi, izni veya denetimi olmadan kullandığı yapay zeka araçlarına ve uygulamalarına “Shadow AI” diyebiliriz. Yukarıda da bahsettiğimiz gibi yapay zeka teknolojilerindeki gelişmeler, ortaya çıkan çözümlerin her geçen gün kalite anlamında iyileşmesi uzmanlıkların yapay zeka araçlarını kullanmalarını üstel bir şekilde yaygınlaştırdı.

IBM’in 2024 yılında yayınladığı rapora göre, yapay zekanın sadece uzmanların elinden çıkıp herkesin kullanabileceği bir araç haline gelmesi, dezavantajların yanı sıra büyük faydalar da getirmiştir. Kullanıcı dostu yapay zeka araçlarının daha geniş çapta yayılması, çalışanların artık gelişmiş yapay zeka yeteneklerine çok daha kolay erişebileceği anlamına gelse de, bu durum aynı zamanda BT ve güvenlik ekiplerinin bilgisi veya izni olmadan bu araçları kullanmalarına da olanak tanıyor. Bu araçların yetkisiz kullanımı ise, şirketleri veri sızıntısı, güvenlik açıkları, düzenlemelere uyumsuzluk (örneğin, KVVK, GDPR) ve itibar kaybı gibi risklere maruz bırakıyor. Sohbet botları, harici makine öğrenimi modelleri, yapay zeka destekli görselleştirme araçları “Shadow AI” kavramının kendini gösterebileceği yerler. Bunlar sıklıkla şirketler içerisinde çalışanlar tarafından günümüzün doğası gereği kullanılır.

Yine 2024 yılında CybSafe ve National Cybersecurity Alliance (NCA) tarafından yapılan bir araştırmaya göre, ABD, İngiltere, Kanada, Almanya, Avustralya, Hindistan ve Yeni Zelanda'daki 7.000 kişiyi kapsayan bir anket; çalışanların %38'inin bu tür araçları izinsiz kullanarak iş yerindeki hassas verileri paylaştığını itiraf ettiğini ortaya koymuştur. Bu oran, Z kuşağı ve Milenyum kuşakları arasında sırasıyla %46 ve %43'e yükselmiştir.

Microsoft 2024 Work Trend Index raporunda da benzer sonuçlar var. Şirketlerin yönetiminin rehberlik veya izin olmadan, çalışanlar işleri kendi ellerine alıyor ve yapay zeka kullanımını gizli tutuyor. Yani çalışanlar yapay zeka kullanımını istiyorlar ve şirketlerin yetişmesini beklemeyecekler.

Bu durum stratejik yapay zeka kullanımından elde edilecek faydayı sınırlı tutmak hatta kaçırmak anlamına geliyor. Daha da önemlisi şirketlerin günümüzde sadece değişimi yakalamak veya yön vermek endişesinin olmadığı, bunlara ek olarak siber güvenlik ve veri gizliliğini korumanın öncelikli olduğunu da ortaya koyuyor.

Araştırmalar ve verilerin ortaya koyduğu üzere çalışanlar için yapay zeka, kariyerleri için çıtayı yükselten, işlerini kolaylaştıran ve kariyer tıkanıklığını ortadan kaldıran bir fırsat durumunda. Liderler için ise, bu fırsatı yatırım getirisine dönüştürmek ve “Shadow AI” tehlikesini yönetebilmek öncelikli.

Yorumlar